A governança de IA nas empresas brasileiras deixou de ser pauta futura — ela é urgente agora. Mais de 60% das pequenas e médias empresas brasileiras já utilizam alguma ferramenta baseada em inteligência artificial no dia a dia: seja o ChatGPT para comunicações internas, plataformas de analytics preditivo ou automações de RPA em processos financeiros. Portanto, a grande maioria opera sem qualquer política formal de governança de inteligência artificial — e isso, do ponto de vista regulatório, representa uma bomba-relógio.

Se a sua empresa está nesse grupo — usando IA de forma produtiva, mas sem framework de controle — este artigo foi escrito para você. Assim, vamos explorar os riscos reais que essa lacuna representa, o que está por vir no cenário regulatório brasileiro e um roadmap mínimo de governança que você pode começar a implementar agora, sem grandes investimentos.

Por que a governança de IA em empresas brasileiras virou prioridade de GRC

Durante anos, IA foi pauta de inovação. Hoje, portanto, ela é pauta de compliance. A mudança de perspectiva não é alarmismo — é uma resposta direta à velocidade com que essas tecnologias passaram a tomar decisões que afetam pessoas, contratos e dados pessoais.

Considere o cenário concreto: um colaborador usa ChatGPT para redigir uma proposta comercial e insere, no prompt, dados de clientes para “personalizar” o texto. Nesse momento, informações pessoais foram transferidas para um servidor externo, sem base legal clara, sem registro de tratamento e sem ciência do titular. Isso é uma violação em potencial da LGPD — com multas que podem chegar a 2% do faturamento, limitadas a R$ 50 milhões por infração. Para aprofundar esse tema, confira nosso artigo sobre adequação à LGPD em 2026.

O risco não é teórico. A Autoridade Nacional de Proteção de Dados (ANPD) já sinalizou que o uso de IA no tratamento de dados pessoais está no radar de suas investigações. Além disso, o marco regulatório brasileiro de IA, atualmente em tramitação no Congresso, deve impor obrigações específicas de transparência, responsabilização e avaliação de impacto para sistemas automatizados de tomada de decisão.

Para o GRC corporativo, isso significa uma coisa simples: quem não estruturar a governança de IA agora vai correr atrás depois — com muito mais custo e muito menos controle. Saiba como o GRC integrado pode ajudar sua empresa a antecipar esses riscos.

Os riscos regulatórios concretos que a governança de IA em empresas brasileiras precisa cobrir

Quando falamos em riscos de IA sem governança, certamente não estamos falando apenas de vazamento de dados. O espectro é, na verdade, mais amplo:

- Violação da LGPD: uso de dados pessoais em prompts de IA sem base legal, sem registro no ROPA e sem cláusulas contratuais com fornecedores de IA.

- Responsabilidade por decisões automatizadas: sistemas de crédito, triagem de RH ou precificação baseados em IA podem gerar discriminação algorítmica — o que já é vedado pelo Código de Defesa do Consumidor e tende a ser explicitamente regulado pelo marco de IA.

- Ausência de trilha de auditoria: sem logs de uso e políticas de retenção, sua empresa não consegue demonstrar conformidade em caso de questionamento regulatório ou litígio.

- Risco de propriedade intelectual: conteúdos gerados por IA com base em dados proprietários ou de terceiros podem gerar disputas sobre autoria e confidencialidade.

- Shadow AI: uso não autorizado de ferramentas de IA por colaboradores — o equivalente moderno do Shadow IT — sem qualquer visibilidade do departamento de compliance.

Esses riscos são especialmente críticos para PMEs porque, diferentemente de grandes corporações, elas raramente têm DPO dedicado, políticas de uso de tecnologia atualizadas ou processos de onboarding que incluam treinamento sobre IA. Por isso, entender como o compliance moderno funciona na prática é o primeiro passo para estruturar uma resposta eficaz.

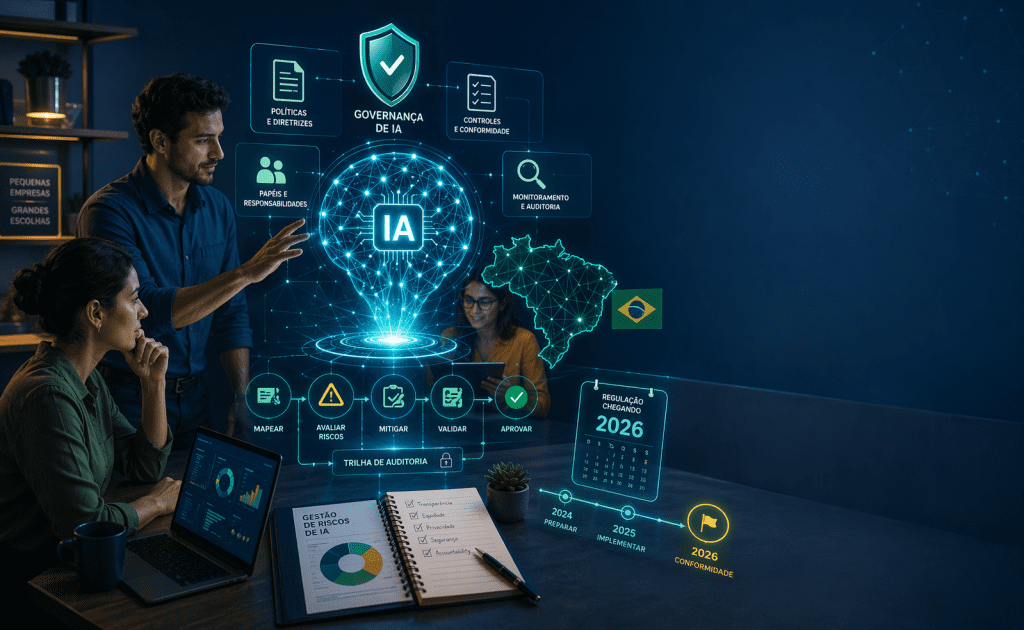

Roadmap mínimo de governança de IA para PMEs brasileiras: por onde começar

A boa notícia é que a governança de IA nas empresas brasileiras não exige um orçamento de grande corporação. Exige, antes de tudo, método. Abaixo, um roadmap em quatro etapas que qualquer PME pode iniciar nos próximos 90 dias:

1. Inventário de ferramentas de IA em uso

Antes de governar, é preciso enxergar. Mapeie, portanto, todas as ferramentas de IA utilizadas na empresa — oficiais e não oficiais. Inclua plugins, extensões de navegador, integrações de CRM e qualquer automação com componente de machine learning. Esse inventário é o ponto de partida para qualquer avaliação de risco.

2. Política de uso aceitável de IA

Redija uma política clara, objetiva e acessível. Ela deve, consequentemente, responder: quais ferramentas são permitidas? Que tipos de dados podem ser inseridos? Quem autoriza novos usos? Qual o processo para reportar incidentes? Não precisa ter 40 páginas — um documento de duas a três páginas, bem comunicado, já eleva significativamente o nível de maturidade. Veja como comprovar compliance na prática com documentação adequada.

3. Avaliação de impacto de privacidade (DPIA) para sistemas decisórios

Se sua empresa usa IA para tomar ou apoiar decisões que afetam pessoas — aprovação de crédito, seleção de candidatos, precificação personalizada — é obrigatório realizar uma avaliação de impacto à proteção de dados. Esse é um requisito explícito da LGPD para tratamento de alto risco e será, certamente, reforçado pelo marco regulatório de IA. Para aprofundar, confira este estudo sobre ESG, LGPD e governança de dados publicado pelo IAPP.

4. Cláusulas contratuais com fornecedores de IA

Revise ou inclua cláusulas de proteção de dados nos contratos com fornecedores de ferramentas de IA. As perguntas essenciais são: onde os dados são armazenados? Por quanto tempo? Eles são usados para treinar modelos? Essas respostas definem diretamente a exposição regulatória da sua empresa.

A plataforma Gopliance permite centralizar esse processo — desde o mapeamento de fornecedores críticos até o gerenciamento de obrigações contratuais relacionadas a privacidade e IA, sem a necessidade de múltiplas planilhas ou ferramentas desconectadas.

Como integrar a governança de IA à sua estrutura de GRC existente

A governança de IA nas empresas brasileiras não é um projeto paralelo — ela deve ser absorvida pela estrutura de GRC que sua empresa já tem (ou está construindo). Na prática, portanto, isso significa:

- Incluir IA no escopo do seu programa de gestão de riscos;

- Criar categorias específicas de risco tecnológico no seu framework de controles internos;

- Incorporar o tema nos treinamentos periódicos de compliance;

- Estabelecer um canal de denúncias eficiente para que colaboradores reportem usos inadequados de IA.

Ao seguir esse caminho, sua empresa não apenas reduz riscos regulatórios imediatos — mas também constrói uma vantagem competitiva real, baseada em confiança, transparência e maturidade operacional.